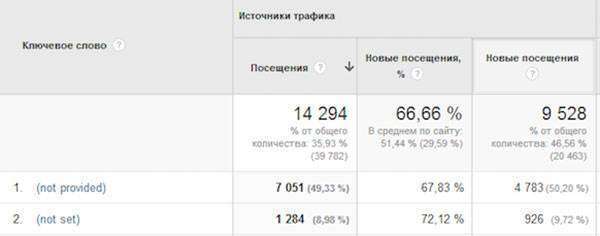

У березні 2014 року Google почав шифрувати абсолютно всі пошукові запити. Тепер в Google Analytics замість пошукової фрази, з якої було абсолютно n-е кількість візитів на сайт, ми побачимо два слова: not provided. Нагадаємо, Яндекс в грудні 2013 року – разом з анонсом про скасування посилального ранжирування також почав шифрувати текст пошукової фрази в заголовку Referer у частині пошукових запитів. Ми припускаємо, що рано чи пізно це станеться з усіма запитами. Причому, швидше рано, ніж пізно.

Резюмуючи, можна сказати: ситуація така, що вже найближчим часом з такою ясністю розуміти, які запити в тематиці генерує переходи, вже буде не можна – це можна буде тільки прогнозувати.

Основний висновок для власників сайтів і сеошників? Просування по позиціях остаточно скасовується. Залишається тільки одне достовірне мірило результативності – пошуковий трафік.

Що таке LSI-копірайтинг

Що взагалі означають всі ці сумні для SEO (і обнадійливі для тих, хто займається просуванням з допомогою контент-маркетингу) новини? Схоже, пошукові гіганти націлилися на планомірне винищення всіх залишилися в пошуковому маркетингу елементів класичного SEO. Це послідовно проведена політика максимального нівелювання маніпулятивних дій з боку оптимізаторів.

Якщо не відомо, за яким запитам ваш сайт отримує трафік, то на підставі чого робити висновок про ефективність того чи іншого просувається ключа/пошукової фрази? Є така думка: якщо ми забудемо про пошукових запитах, залишимо спроби відстежити, яким запитам повинна бути релевантна та чи інша сторінка сайту, то релевантність в підсумку на сторінці «розмита». Але насправді все не так. Все чесно: про що ви випишіть на сторінці – тому вона і релевантна.

Тут важливо зрозуміти, що релевантність – це вже давно не щільність ключа на сторінці. І ми розуміємо, про що говоримо. Ми самі багато років тому розробили скрипт оцінки щільності ключа на підставі сайтів, що знаходяться в ТОП-20 пошукової видачі з того чи іншого запиту. І, загалом-то, з 2010-го ми вже ним не користуємося самі 🙂 – це просто ні до чого. Релеватность більше не стосується фраз-маячків, вписаних в текстовий контент, релевантність у часи семантичного пошуку стосується сенсу, змісту.

Тренд найближчих кількох років – це так званий LSI-копірайтинг.

З абревіатурою LSI все більш менш зрозуміло: це латентно-семантичне індексування (latent semantic indexing), метод індексування прихованої семантики – семантики, змінює значення залежно від контексту. Саме завдяки LSI пошуковики вчаться розуміти природну мову запитів.

У відповідь на рух пошуковиків в бік семантичного пошуку виник так званий LSI-копірайтинг. LSI-копірайтинг в найближчі два-три роки скасує seo-копірайтинг повністю.

Як змінюється поняття «релевантність» з вдосконаленням семантичного пошуку

Що ми розуміємо під seo-копірайтингом? Робота з текстом на підставі переліку вписуваних ключів і щільності їх вписування. Чому він буде існувати ще найближчі два-три роки? Зовсім не тому, що вписування ключів сьогодні ефективно. Просто інертність ринку величезна, саме тому робота з текстом по щільності ключів буде якийсь час ще жити.

Вписування ключів (seo-копірайтинг) не актуальне, не ефективний і навіть шкідливий вже роки два як. Все почалося в 2011-му – з алгоритму Panda, найбільшого за значимістю в історії оновлень алгоритмів Google. Основне, що говорять про Panda: цей алгоритм був націлений на боротьбу з неякісними текстами. Але це не зовсім так. Насправді Panda оцінював взаємодія користувача з сайтом, ще точніше – ступінь залученості при перегляді вмісту веб-сторінки. Очевидно, що текстовий контент відіграє величезну роль при формуванні думки відвідувача сторінки. І з цієї точки зору правомірно говорити, що Panda – це початок серйозної боротьби з неякісними текстами (хоча зводити все це оновлення до одного тільки якістю тексту, звичайно, неправильно). Після введення цього алгоритму видача Google очистилася від величезної кількості текстових ферм і сайтів, на яких тексти явно були створені заради вписування ключів, а не для людей.

Але, за великим рахунком, справжній прорив в області семантичного пошуку стався з введенням в 2013 році алгоритму Hummingbird (Колібрі). З цього моменту почалася справжня історія LSI-копірайтингу.

Hummingbird був представлений на прес-конференції, присвяченій 15-річчю Google. Тоді керівник напрямку по розробці пошукової системи Аміт Сміт зазначив, що Humminbird – найсерйозніше з 2001 року оновлення. З його введенням почався період обробки пошукових запитів не стільки по ключам, скільки за змістом. Як заявили в Google, це нововведення – відповідь на те, що люди почали рідше вводити в рядок пошуку лаконічні запити, що містять ключові фрази, і все частіше стали використовувати при пошуку «природні» запити – просто фрази розмовної мови, досить часто складні і довгі. Hummingbird «умів» оброблювати такі запити.

Таким чином, сьогодні має сенс говорити про «релевантності смислів», а не про «релевантності слів-маячків» на сторінці, що є серйозним еволюційним кроком в семантичному пошуку.

Фактично мова йде про те, що пошук прагне «прочитати» і «переказати» текст своїми словами – а це – ні більше, ні менше – заявка на штучний інтелект. Поки, правда, жоден робот не пройшов цей «текст для першокласників», але еволюція в цьому напрямку йде вражаючими темпами.

До чого все йде?

Відразу згадується, наскільки серйозно Google останнім часом почав фокусуватися на розробках, пов’язаних із створенням штучного інтелекту. В січні 2014-го Ларрі Пейдж особисто курирував придбання компанією Google лондонської фірми DeepMind Technologies, орієнтованої на створення алгоритмів глибокого машинного навчання, з використанням напрацювань у галузі нейробіології.

А незадовго до цього пошуковий гігант купив Boston Dynamics – всесвітньо відому інженерну компанію, що розробляє, мабуть, найбільш просунутих роботів на цій планеті.

Одна з військових розробок Boston Dynamics — BigDog. Призначений для переміщення на місцевості, де не може пересуватися звичайний транспорт. Довжина робота — 0,91 м, висота — 0,76 м, вага -110 кг

Google орієнтований на глибоке навчання і, ймовірно, на створення розумного машинного «мозку». Більш того, в компанії створена комісія з етики, яка буде спостерігати за тим, щоб розробка штучного інтелекту йшла в «правильному» з точки зору загальноприйнятих гуманних норм напрямку.

Після цього, який залишається шанс, що Google залишить можливість робити хоч якісь маніпулятивні впливи на видачу? Ніякого.

Сенс в тому, що чим більше ви будете думати про інтереси людей (аудиторії) і чим менше про те, як за рахунок недосконалостей пошуковика можна накрутити трафік, – тим легше вам буде рости і отримувати лояльну аудиторію. Створюйте контент для людей, покращуйте сайти, щоб відвідувачам було зручно ними користуватися. Оптимізація скінчилася, залишився чистої води маркетинг в Мережі. Думайте про те, що потрібно вашій ЦА, і давайте їй – що ще тут можна сказати?

Ну і спеціально для тих, хто сумнівається в тому, що технологічна сингулярність буде досягнута. Подивіться на відео нижче. І після такого ви все ще сумніваєтеся?

Базові руху цього робота задані алгоритмом. Але він сам приймає рішення, які рухи використовувати – в залежності від типу звучної музики і ритму.

Читайте також:

- Як збільшити швидкість завантаження сайту?

- Фільтр аффіліатів в питаннях і відповідях

- Як проводити A/B-тестування